|

|

#41 |

|

Специалист

|

спасибо за обновление! стало уже легче

еще бы экспорт в CSV файл, чтобы получать файл из экселя как "внешние данные", было бы вообще блаж  Смысл в том, что екселевский файл был бы уже настроен под меня. и после каждой проверке я получал бы в файл только данные, а дизайн бы файла, был бы уже настроен мною под меня, а не менялся бы каждый раз... проверьте личку. Я написал вам сообщение о сотрудничестве  Последний раз редактировалось Andrej; 02.01.2011 в 23:52. |

|

|

|

|

|

#43 |

|

Специалист

|

Комплексный анализ сайта.

Если проверяю домен без сайта, то вылетает "ошибка обращения к сайту .... 500 внутренняя ошибка..." Опция в конфиге "прерывать анализ при возникновении критической ошибки" выключена... однако все равно программа не даем проверять домен... Ну блин, убрали бы все эти ограничения! Ведь есть не только сайты, но и освобожденные домены еще без сайтов.... но с какими то характеристиками, которые нужно проверять! |

|

|

|

|

|

#44 | |||

|

Новичок

Регистрация: 16.03.2010

Сообщений: 58

Вес репутации: 173

|

Цитата:

Добавлено через 18 часов 17 минут Цитата:

Цитата:

Последний раз редактировалось iGenek; 05.01.2011 в 15:08. Причина: Добавлено сообщение |

|||

|

|

|

|

|

#46 |

|

Новичок

Регистрация: 16.03.2010

Сообщений: 58

Вес репутации: 173

|

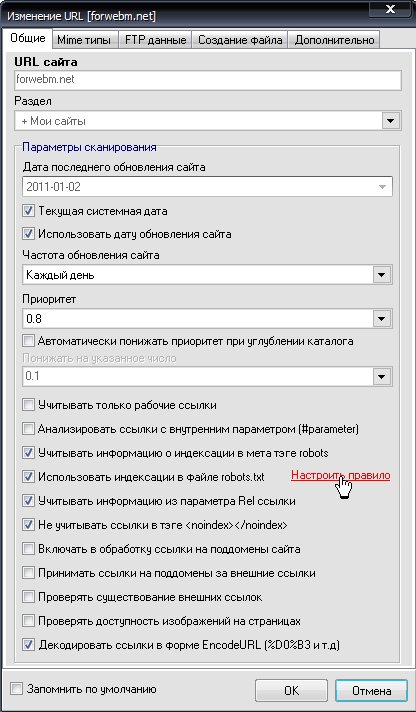

Доступно обновление программы v1.3.5.3

Изменения: - Добавлена поддержка выбора источника(ов) данных для получения информации о сайте.  Данная опция позволяет использовать от 1 до нескольких источников для получения данных о сайте. *** Если выбран один источник - данные обрабатываются на указанном источнике, если не выбран ни один источник - данные обрабатываются стандартным для текущих данных источником, если выбрано несколько источников - данные обрабатываются всеми выбранными источниками, затем выбирается максимальный результат (увеличивает расход трафика). Кэш для каждого источника разный! Добавлено через 23 часа 43 минуты Изменения сервиса "Управление SiteMap" - Добавлена опция (Декодировать ссылки в форме EncodeURL (%D0%B3 и т.д)) в сервис "Управление SiteMap" - позволяет автоматически декодировать ссылки на страницах сайта, размещенных в экранированном виде (состоящих из %D0%B3 и т.д) - Добавлена опция "Использовать системную дату обновления сайта" для автоматического выставления системной даты для страниц при сканировании. - Изменен алгоритм распределения страниц между потоками сканеров. Фиксирована поддержка стабильности скорости и нагрузки на систему при различных ситуациях во время сканирования. Снижена нагрузка на систему при сканировании. Увеличена скорость сканирования. Последний раз редактировалось iGenek; 07.01.2011 в 18:51. Причина: Добавлено сообщение |

|

|

|

|

|

#47 |

|

Специалист

|

При экспорте в ексель или в CSV, есть возможность выключать ненужные показатели, и менять их местами. "Запомнить по умалчиванию" включено, но не запоминает.

Каждый раз при сохранении приходится руками выключать ненужные показатели и менять их как нужно... неудобно! |

|

|

|

|

|

#48 | |

|

Новичок

Регистрация: 16.03.2010

Сообщений: 58

Вес репутации: 173

|

Цитата:

Выстраивание списка параметров по идентичности с положением параметров в сервисе (для экспорта), при этом выделены те параметры, которые отображаются в сервисе, те что скрыты - отключены и в списке. - Сделано. (Обновите программу!) |

|

|

|

|

|

|

#49 |

|

Новичок

Регистрация: 16.03.2010

Сообщений: 58

Вес репутации: 173

|

Доступно обновление программы: v1.3.5.5

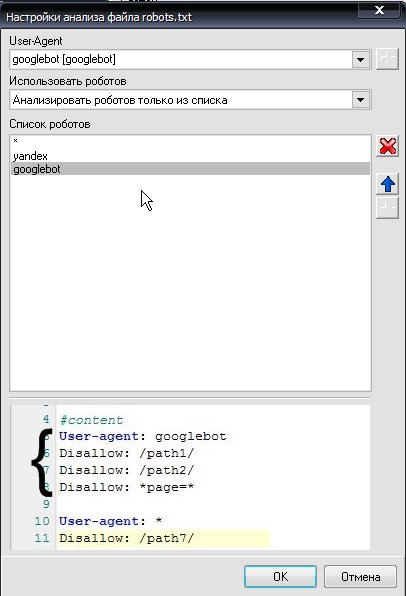

Изменения: - Добавлена возможность настройки правил анализа файла robots.txt при сканировании сайта в сервисе "Управление SiteMap" Настройка правила доступна из окна добавления/изменения параметров сайта. Настройка устанавливается для каждого сайта в отдельности.  Вид окна настройки правил сканирования:  Правило позволяет установить список роботов, учет которых будет вестись при анализе запрета индексации при обходе сайта. - Если Выбрано: "Использовать для анализа весь файл" Будет анализироваться все содержимое файла robots.txt (все блоки роботов). При запрете индексации будет учтен первый из всех запретов. Весь файл также будет анализироваться при любом другом типе анализа, если список роботов пуст. - Если выбрано: "Анализировать всех роботов, кроме тех что в списке" При таком типе анализа будут участвовать в анализе запрета все блоки роботов ( например: User-Agent: yandex disallow: / allow: /page и так до следующего блока или конца файла.. ) кроме роботов, указанных в списке. - Если выбрано "Анализировать роботов только из списка" Будут учитываться блоки роботов только тех, которые указаны в списке. |

|

|

|

|

|

|

Похожие темы

Похожие темы

|

||||

| Тема | Автор | Раздел | Ответов | Последнее сообщение |

| Как перевести средства из вебмастера в оптимизатора | PetrZw | Вопросы от новичков | 2 | 30.05.2009 12:39 |

| Сайт вебмастера отсутствует в поиске оптимизатора | mr.webman | Вопросы по работе системы | 10 | 25.03.2009 13:19 |

| Разделение счетов вебмастера и оптимизатора | asd111 | Пожелания пользователей системы | 3 | 28.02.2009 23:42 |

| Необходимость года в списке ссылок оптимизатора и вебмастера | spellen | Вопросы по работе системы | 16 | 02.10.2008 13:08 |

| Как посмотреть на себя (вебмастера) глазами оптимизатора? | abo | Яндекс | 13 | 27.11.2007 11:06 |

Часовой пояс GMT +3, время: 19:26.